Üretken Yapay Zeka’nın sağlık sektörüne entegrasyonu hız kazanıyor!

Görüntü, metin, ses ve video oluşturma yetenekleriyle dikkat çeken Üretken Yapay Zeka, büyük teknoloji firmalarından bağımsız girişimlere kadar pek çok aktör tarafından sağlık hizmetlerine entegre ediliyor. Google Cloud, Pittsburgh merkezli Highmark Health ile işbirliği yaparak hasta deneyimini kişiselleştirmeyi hedeflerken, Amazon’un AWS bölümü tıbbi veri analizi üzerine çalışmalar yürütüyor. Microsoft Azure ise Providence sağlık hizmetleri ağı için otomatik olarak hasta mesajlarının sıralandığı sistemler geliştiriyor.

Sektörde yapay zekaya yönelik artan ilgi, yatırımlarla da kendini gösteriyor. Özellikle Ambience Healthcare, Nabla ve Abridge gibi şirketler, klinisyenlere yönelik Üretken Yapay Zeka uygulamaları geliştirerek dikkat çekiyor. Yapılan yatırımlar, yapay zekanın sağlık hizmetlerindeki potansiyeline olan inancını gözler önüne seriyor.

Ancak bu teknolojiye yönelik genel bir kabul söz konusu olduğunu söylemek oldukça zor. Yapılan anketler, tüketicilerin yarısının yapay zekanın sağlık hizmetlerini iyileştirebileceğine inandığını gösteriyor. Öte yandan, yapay zekanın kullanımı ile genel kısıtlamalar ve yanlış teşhis riskleri, teknolojinin sağlık sektöründe etkin bir şekilde kullanılmasına yönelik endişeleri artırıyor. Bu durum, Üretken Yapay Zeka araç gereçlerinin sağlık hizmetlerinde ne ölçüde faydalı olabileceği konusunda tartışmalara neden oluyor.

Buna karşın, bazı uzmanlar yapay zekanın genel olarak sağlık hizmetlerini dönüştürme potansiyeline hala inanıyor. Ancak bu inancın, teknolojinin sınırlamaları ve riskleri dikkate alınarak dengelenmesi gerektiğini vurguluyorlar.

Yakın zamanda yapılan bir Deloitte anketinde, ABD’li tüketicilerin yalnızca yarısı (%53), üretken yapay zekanın sağlık hizmetlerini iyileştirebileceğini düşündüklerini söylüyor. Sağlık hizmetlerindeki erişilebilirliği artırma ve randevu bekleme sürelerini kısaltma durumları yapay zekanın görev yapabileceği alanlara örnek olarak veriliyor. Geri kalan yüzdelik kısım ise üretken yapay zekanın insanların sağlık alanında alması gereken tıbbi bakım masraflarını daha uygun fiyatlı hale getirmesini beklediklerini söylüyor.

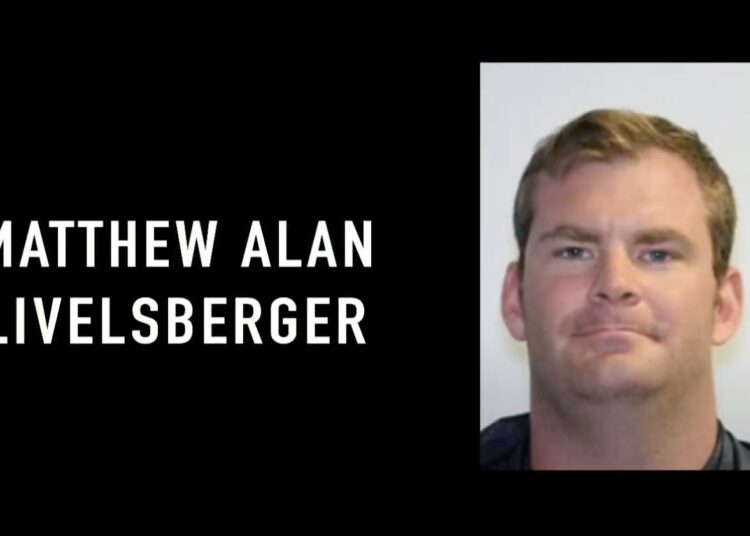

ABD Gazi İşleri Bakanlığı’nın en büyük sağlık sistemi olan VA Sunshine Healthcare Network’ün baş yapay zeka sorumlusu Andrew Borkowski, yapay zeka hakkındaki bu şüpheci tavrın yersiz olduğunu düşünmüyor. Buna rağmen Borkowski, üretken yapay zekanın “önemli” sınırlamalarına ilişkin endişeler nedeniyle bir tartışma ortamı oluşmasının şu anlık erken olabileceği konusunda da uyarılını yapıyor.

Borkowski’nin bazı haber kaynaklarına verdiği demeçte, “Üretken Yapay Zeka uygulamaları ile ilgili temel sorunlardan biri, karmaşık tıbbi sorguları veya acil durumları ele alamamasıdır. Sınırlı bilgi tabanı ve güncel klinik bilgilerin yokluğu ile insan uzmanlığının eksikliği, yapay zekayı kapsamlı tıbbi tavsiye veya tedavi önerileri sağlamak için uygun hale getirmekten uzaklaştırıyor” dedi.

Borkowski’nin bazı haber kaynaklarına verdiği demeçte, “Üretken Yapay Zeka uygulamaları ile ilgili temel sorunlardan biri, karmaşık tıbbi sorguları veya acil durumları ele alamamasıdır. Sınırlı bilgi tabanı ve güncel klinik bilgilerin yokluğu ile insan uzmanlığının eksikliği, yapay zekayı kapsamlı tıbbi tavsiye veya tedavi önerileri sağlamak için uygun hale getirmekten uzaklaştırıyor” dedi.

Borkowski’nin endişelerini doğrulayan araştırmalarda bu hususta ortaya koyuluyor.

JAMA Pediatrics dergisindeki bir makalede, OpenAI’ın bazı sağlık kuruluşlarının sınırlı kullanım durumları için pilot olarak uyguladığı ChatGPT adlı üretken yapay zeka sohbet robotunun, pediatrik hastalıkların teşhisinde %83 oranında hata yaptığı tespit edildiği biliniyor. Ve testlerde Boston’daki Beth Israel Deaconess Tıp Merkezi’ndeki doktorlar, OpenAI’ın GPT-4 modelini bir teşhis asistanı olarak kullandıklarında, modelin neredeyse üçte iki kez yanlış teşhisi en iyi cevap olarak sıraladığını gözlemlediler.

Günümüzün üretici yapay zekası, tıp çalışanlarının günlük iş akışlarının bir parçası olan tıbbi idari görevlerle de mücadele ediyor. Üretken yapay zekanın hasta sağlık kayıtlarını özetleme ve notlar arasında arama yapma gibi işleri ne kadar iyi yapabildiğini değerlendirmek için yapılan MedAlign karşılaştırmasında GPT-4 vakaların %35’inde başarısız oldu. Teknik detay ve verileri bu linkten inceleyebilirsiniz: https://arxiv.org/abs/2308.14089

OpenAI ve diğer birçok yapay zeka tedarikçisi tıbbi tavsiye için modellerine güvenilmemesi konusunda kendi sitelerinde uyarılar yayınlıyor. Ancak Borkowski ve diğerleri daha fazlasını yapabileceklerini iddia ediyorlar. Borkowski, “Sağlık hizmetleri için yalnızca üretken yapay zekaya güvenmek yanlış teşhislere, uygunsuz tedavilere ve hatta yaşamı tehdit eden durumlara yol açabilir” diyerek kuşkularını yineliyor.

Duisburg-Essen Üniversitesi’nin Tıpta Yapay Zeka Enstitüsü’nde, hasta bakımı için yeni teknolojilerin uygulamalarını inceleyen yapay zeka rehberliğinde gerçekleşen tedavileri yöneten Jan Egger de Borkowski’nin endişelerini paylaşıyor. Şu anda sağlık hizmetlerinde üretken yapay zekayı kullanmanın tek güvenli yolunun bir hekimin yakın ve dikkatli gözetimi altında olduğuna inanıyor.

Egger, “Sonuçlar tamamen yanlış olabilir ve bunun farkındalığını sürdürmek gittikçe zorlaşıyor” dedi. “Elbette, üretken yapay zeka, örneğin taburcu mektuplarının önceden yazılması için kullanılabilir. Ancak hekimlerin bunu kontrol etme ve son kararı verme sorumluluğu var” dedi.

Generative AI (Üretken Yapay Zeka) basmakalıp bilgileri tekrar etme potansiyeline sahip

Sağlık hizmetlerinde üretken yapay zekanın işleri yanlış yapabilmesinin özellikle zararlı bir yolu, basmakalıp bilgileri devam ettirmektir.

Stanford Medicine tarafından 2023 yılında yapılan bir çalışmada, bir grup araştırmacı ChatGPT ve diğer yapay zeka destekli sohbet robotlarını böbrek fonksiyonu, akciğer kapasitesi ve deri kalınlığı ile ilgili sorular üzerinde test etti. Araştırmacılar ChatGPT’nin yanıtlarının sıklıkla yanlış olmakla kalmadığını, aynı zamanda yanıtların siyahi ve beyaz insanlar arasında biyolojik farklılıklar olduğuna dair uzun süredir devam eden doğru olmayan inançları da pekiştirdiğini tespit etti. Bu doğru olmayan inançların tıbbi sağlayıcıların sağlık sorunlarını yanlış teşhis etmesine yol açtığı biliniyor.

İronik olan şu ki, sağlık hizmetleri için üretken yapay zeka tarafından ayrımcılığa uğrama olasılığı en yüksek olan hastalar, aynı zamanda bunu kullanma olasılığı en yüksek olan hastalardır.

Sağlık hizmeti kapsamı olmayan kişiler genel olarak beyaz tenli olmayan kişiler olduğu biliniyor. Deloitte anketine göre, genç Asyalı ve Hispanik kişiler, beyaz meslektaşlarına göre daha yüksek oranda (%20.6) sigortaya sahip olmama eğilimindedirler. Eğer yapay zeka önerileri önyargılarla etkilenirse, bu tedavi eşitsizliklerini daha da artırabilir.

Ancak bazı uzmanlar, üretici yapay zekanın bu konuda gelişme gösterdiğini savunuyor.

2023’ün sonlarında yayınlanan bir Microsoft çalışmasında, araştırmacılar GPT-4 kullanarak dört zorlu tıbbi kriterde %90,2 doğruluk elde ettiklerini söyledi. Düz GPT-4 modeli bu skora ulaşamamıştı. Ancak araştırmacılar, prompt mühendisliği yoluyla GPT-4’ün belirli çıktıları üretmesi için belirli istekleri içeren promptlar tasarlayarak modelin puanını yüzde 16,2’ye kadar artırabildiklerini söylüyorlar. Bu alanda Microsoft’un OpenAI üzerinde büyük bir yatırımcı olduğunu belirtmek gerekir.

Bir sohbet botuna sorulan soruyu cevaplamak, üretken yapay zekanın iyi olduğu tek şey değil. Bazı araştırmacılar, tıbbi görüntülemenin üretken yapay zekanın gücünden büyük ölçüde faydalanabileceğini söylüyor.

Bir sohbet botuna sorulan soruyu cevaplamak, üretken yapay zekanın iyi olduğu tek şey değil. Bazı araştırmacılar, tıbbi görüntülemenin üretken yapay zekanın gücünden büyük ölçüde faydalanabileceğini söylüyor.

Temmuz ayında, bir grup bilim insanı Nature dergisinde yayınlanan bir çalışmada, klinik iş akışına tamamlayıcılık odaklı erteleme (CoDoC) adı verilen bir sistemi tanıttı. Sistem, tıbbi görüntüleme uzmanlarının teşhis için geleneksel tekniklere karşı ne zaman yapay zekaya güvenmeleri gerektiğini anlamak için tasarlandı. Ortak yazarlara göre CoDoC, klinik iş akışlarını %66 oranında azaltırken uzmanlardan daha iyi performans gösterdi.

Kasım ayında Çinli bir araştırma ekibi, X-ışınlarındaki potansiyel pankreas lezyonlarını tespit etmek için kullanılan bir yapay zeka modeli olan Panda’yı tanıttı. Yapılan bir çalışma Panda’nın, cerrahi müdahale için genellikle çok geç tespit edilen bu lezyonları sınıflandırmada son derece başarılı olduğunu gösterdi.

Nitekim Oxford Üniversitesi’nde klinik araştırma görevlisi olan Arun Thirunavukarasu, üretken yapay zekanın sağlık hizmetleri ortamlarında kullanılmasını engelleyen “herhangi bir şey” olmadığını söyledi.

Thirunavukarasu, “Üretken Yapay Zeka teknolojisinin daha sıradan uygulamaları kısa ve orta vadede uygulanabilir ve metin düzeltme, notların ve mektupların otomatik olarak belgelenmesi ve elektronik hasta kayıtlarını optimize etmek için geliştirilmiş arama özelliklerini içerir. Yapay zeka bu alanlarda etkili olduğu takdirde bu tür rollerde hemen kullanılmaması için hiçbir neden yok” dedi.

Ancak üretken yapay zeka tıbbın belirli, dar alanlarında umut vaat ederken, Borkowski gibi uzmanlar, üretken yapay zekanın çok yönlü bir yardımcı sağlık hizmeti aracı olarak yararlı ve güvenilir olabilmesi için aşılması gereken teknik ve uyum engellerine işaret ediyor.

Ancak üretken yapay zeka tıbbın belirli, dar alanlarında umut vaat ederken, Borkowski gibi uzmanlar, üretken yapay zekanın çok yönlü bir yardımcı sağlık hizmeti aracı olarak yararlı ve güvenilir olabilmesi için aşılması gereken teknik ve uyum engellerine işaret ediyor.

VA Sunshine Healthcare Network’ün baş yapay zeka sorumlusu Andrew Borkowski, “Sağlık hizmetlerinde Üretken Yapay Zeka teknolojisinin kullanımını çevreleyen önemli gizlilik ve güvenlik endişeleri var. Tıbbi verilerin hassas yapısı ve kötüye kullanım veya yetkisiz erişim potansiyeli, hasta gizliliği ve sağlık sistemine güven açısından ciddi riskler oluşturmaktadır. Ayrıca, sağlık hizmetlerinde üretken yapay zekanın kullanımını çevreleyen düzenleyici ve yasal ortam hala gelişmekte olup, sorumluluk, veri koruma ve insan dışı varlıklar tarafından tıp uygulamasına ilişkin soruların hala çözülmesi gerekmektedir” dedi.

Oxford Üniversitesi’nde klinik araştırma görevlisi olan Arun Thirunavukarasu bile, sağlık hizmetlerinde üretken yapay zeka konusunda olduğu gibi, hastaya yönelik araçların arkasında “titizlikle yapılan bir bilimsel çalışma” olması gerektiğini söylüyor.

Thirunavukarasu, “Özellikle doğrudan klinisyen gözetimi olmadan, hastaya yönelik üretken yapay zekanın dağıtımını haklı çıkarmak için klinik faydayı gösteren pragmatik rasgele kontrol denemeleri yapılmalıdır. İleriye dönük uygun yönetim ve geniş ölçekte konuşlandırmanın ardından beklenmedik zararları yakalamak için gereklidir” dedi.

Kısa bir süre önce Dünya Sağlık Örgütü, sağlık hizmetlerinde bu tür bir bilim ve insan gözetiminin yanı sıra bağımsız üçüncü taraflarca bu yapay zeka üzerinde denetim, şeffaflık ve etki değerlendirmelerinin başlatılmasını savunan kılavuzlar yayınladı. Dünya Sağlık Örgütü’nün kılavuz ilkelerinde, sağlık hizmetleri için üretken yapay zekanın geliştirilmesinde çeşitli insan gruplarının katılımını teşvik etmek ve süreç boyunca endişelerini dile getirme ve girdi sağlama fırsatı sunmanın hedef olacağı belirtiliyor.

Borkowski, “Endişeler yeterince giderilene ve uygun önlemler alınana kadar tıbbi üretken yapay zekanın yaygın olarak uygulanması hastalar ve bir bütün olarak sağlık sektörü için potansiyel olarak zararlı olabilir” dedi.