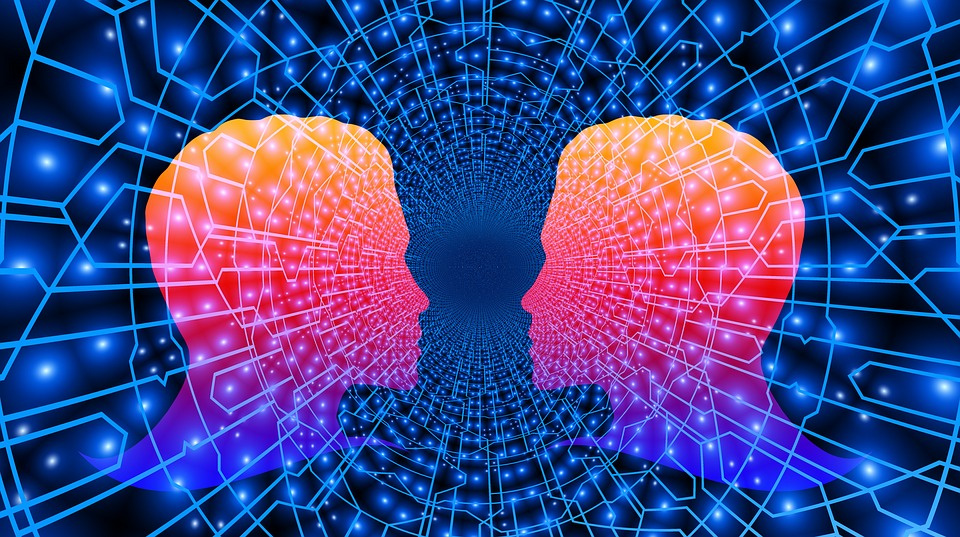

ABD’de başkanlık seçimleri yaklaşırken, yapay zeka sektöründeki son gelişmelerle birlikte insan elinden çıkmış metinlerden ayırt edilmesi imkansız hale geldi.

OpenAI tarafından geliştirilip GPT-3 adı verilen bir dil modelleyicisi olan yeni yapay zeka ürününün yetenekleri ve yapabilecekleri gerçekten etkileyici. Yapay zeka kendisine verilen belirli bir metin komutu istemine cevaplar oluşturmak üzere geliştirildi. Cevaplar arasında kendisine sorulan soruları yanıtlama, çeşitli kurgular ve şiirler yazma, basit web sayfaları ve SQL kodları oluşturma yer alıyor.

OpenAI yaptığı bir açıklamayla GPT-3’ün kullanımının yalnızca etik kurallar çerçevesinde devam edeceği ve şu anda özel beta sürümünde olan uygulama, programlama arayüzünü yakından izleyeceği sözünü verdi. Ancak bu tür yazılım geliştirmelerinde bazen API anahtarlarının paylaşıldığına veya kamuya açık alanlarda yanlışlıkla açığa çıktığına da şahit olunmuştu.

Bunun dışında can sıkıcı olan şeylerden birisi de yapay zekanın kurgu haberler üretme konusundaki yeteneğinin mükemmel olması. Bu haberlerin üretilmesi ise son derece kolay görünüyor. Uygulamaya bir başlık ve alt başlık verildikten sonra, yapay zeka devreye girip makalenin tamamını oluşturabiliyor.

Geliştirilen yapay zekanın belli bir siyasi görüşü, partiyi veya kişiyi destekleyen birer başlık ve alt başlıkla çalıştırılması durumunda, yaklaşan ABD seçimlerinin etkilenmesi ihtimalini zihinlerde görselleştirmek oldukça kolay. OpenAI, yaptığı araştırmalarda önceden bilgilendirilmemiş olan okuyucuların mevzubahis yapay zeka tarafından yazılmış bir haberi okuduktan sonra haberin insan elinden mi yoksa uygulamadan mı çıkmış olduğunu doğru bir şekilde bulamadığını belirledi. Son zamanlardaysa bu yapay zeka tarafından oluşturulan ve popüler teknolojik haber sitesinde yayınlanan bir makale çoğu okuyucu içeriğin yapay zekayla üretildiğini fark etmeden sitenin en çok okunanları arasında girdi.

Yapay zeka tarafından sağlanan bu yeniliğin 2016 seçimleriyle alakalı olarak, dillerden düşmeyen ve insanlar tarafından oluşturulan tuhaf kurgu hikayeleriyle hiçbir benzer yanı yok, zira yapay zekanın oluşturduğu kurgular oldukça orijinal ve ikna edici içerikler barındırıyor.

Oxford Üniversitesi, yaptığı bir araştırmada 2016 başkanlık seçimleri sırasında Michigan kaynaklı olan ve Twitter’da paylaşılan tüm haberlerin yarısına yakınının teyitsiz/güvenilemeyen kaynaklardan geldiğini ortaya koymuştu. Profesyonel gazetecilikten ayırt edilmesi zor ve gerçekçi içerikler üretilerek 2016 seçimleriyle ilgili olarak belirlenen bu yüzde çok daha yüksek seviyelere çekilebilir ve gerçek haberler yapay zekalar tarafından üretilen dev yığınların içine gömülebilir.

Geliştirilen yapay zeka, aynı zamanda belli başlı politik konular hakkında kamuoyunda bir fikir birliği oluşturmak için de kullanılabilir. Federal İletişim Komisyonuna bağlı Pew Araştırma Merkezi tarafından 2014’te yapılan internet tarafsızlık araştırması 21,7 milyon internet yorumunun sadece %6’sının orijinal ve özel olduğunu ortaya koymuştu. Geri kalan yorumlar birbirinin kopyaları olarak tanımlandı ve bu oran yüzde 94’ü buldu. Bu çoğunluğun neredeyse tamamı ise internet tarafsızlık düzenlemelerine karşı çıkmıştı. Yapay zekalar tarafından oluşturulacak olan gerçekçi yorumların tespit edilmesi ise muhtemelen bu araştırmaya konu olan yorumlardan çok daha zor olacak. Benzer şekillerde oluşturulacak olan dezenformasyon botları sosyal medya siteleri ve forumlarda belli görüşlerin kabul görmesini veya kabul görüyormuş gibi görünmelerini sağlamak için de kullanılabilirler. Çünkü araştırmalar bireylerin kararlarının başkalarının kararlarından kolay bir şekilde etkilendiğini göstermektedir.

Peki yapay zekalar tarafından oluşturulacak metnin seçmenler üzerindeki etkisini ne azaltabilir?

Bu sorunun çözümü için GPT-3 veya benzerleri tarafından oluşturulan metinleri ayırt edebilmek için ikinci bir yapay zeka geliştirilmesi düşünülebilir, böylece kullanıcıya yapay zekayla oluşturulmuş içerikler için bir uyarı gönderilebilir. Örneğin, genellikle politik figürlerin kurgulanmış ifadelerini içeren derin sahtelik özelliğine sahip (ayırt edilmesi zor derecede profesyonel) videoların belirlenmesinde bazı ilerlemeler kaydedildi.

OpenAI’den yapılan açıklamada GPT-3 tarafından oluşturulan bir makaledeki yapısal yanlışlıkların, tekrarların, bağlam bakımından tutarlı olmayan ve olağandışı ifadelerin yapay zekalar tarafından oluşturulan yazılar için ayırt edici olabileceği ancak bu göstergelerin oldukça küçük noktalar halinde karşımıza çıkabileceğini belirtti. Çoğu okurun makaleleri okurken onları bu tarz özelliklere göre incelemediği, gözden geçirmediği göz önüne alındığındaysa, bu tür göstergelerin gözden kaçması oldukça muhtemel görünüyor. İkinci bir yapay zeka programlamasının yapılması ve bu ipuçlarını daha tutarlı bir şekilde yakalayabilme ihtimali makul görünüyor, ancak bu rakiplerin de hızla yenilikler üzerinde çalıştığı bir yapay zeka-silahlanma yarışına dönüşebilir ve her bir yapay zeka programı bir diğerini aldatma konusunda giderek daha iyi hale getirilebilir.

Yapay zekalar ve onların yeteneklerinin ulaşabileceği sınırlar yavaş yavaş gün yüzüne çıktığından, çeşitli gruplaşmalar da vakit kaybetmeden elde edilen verileri kopyalamaya ve hem kişisel hem de politik kazanç için bunlardan yararlanmaya çalışacaktır. Kötü niyetli aktörlerin işin sonunda bu tür bir teknolojiyi benimseyip benimsemeyeceğinin ise yapay zekaların onların amaçlarına ve iş düzenlerine hizmet edip etmeyeceğine bağlı olacağı değerlendiriliyor. Daha önceki dil modelleyicilerin piyasaya sürülmesi ve kullanımları yakından izlenmiş, uygulamaların kötü niyetli gruplar tarafından benimsendiği konusunda çok az kanıt bulunmuştu. Ancak bu teknoloji daha gerçekçi ve daha güvenilir hale geldikçe tabii olarak onlar için de daha çekici bir ürün haline dönüşebilir.

Editör : SavunmaTR Haber Merkezi